10 دقیقه

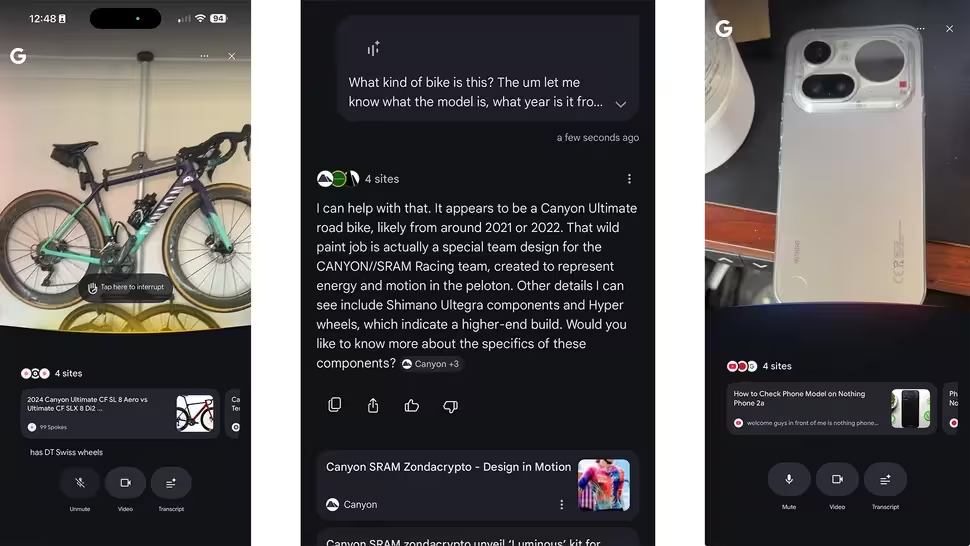

شما دوربین گوشیتان را به سمت چیزی میگیرید — یک دوچرخه، ماشین لباسشویی یا یک گجت تصادفی — و فقط میپرسید. نه تایپ کردن، نه اسکرول کردن. حرکت جدید گوگل میخواهد که جستجو کمتر شبیه یک کادر پرسش باشد و بیشتر شبیه یک گفتوگوی زنده و در لحظه.

«جستجوی زنده»، قابلیت گفتوگوی جستجوی مبتنیبر هوش مصنوعی گوگل، اکنون بهطور پنهانی در بیش از ۲۰۰ کشور در دسترس قرار گرفته و از ۹۸ زبان پشتیبانی میکند. این ابزار که اولین بار اواخر سال ۲۰۲۵ در ایالات متحده عرضه شد، ورودی دوربین، تعامل صوتی و پاسخهای تولیدشده توسط هوش مصنوعی را در یک تجربه یکپارچه ترکیب میکند. کمتر «جستجو» و بیشتر «گفتوگو با اینترنت» است.

نحوه عملکرد در عمل چنین است: اپلیکیشن گوگل را باز کنید، دکمه «Live» را لمس کنید و دوربین را نشان دهید. سؤال را بلند بپرسید — این دستگاه چه مدلی است، چگونه کار میکند، دارم به چه چیزی نگاه میکنم — و سیستم فورا با پاسخهای گفتاری و زیرنویسهای کامل به شما پاسخ میدهد. این فقط یک پاسخِ تکمرحلهای نیست؛ سیستم همچنان گوش میدهد و آماده پیگیری، شفافسازی یا حتی تغییر جهت در میانهی مکالمه است.

این تجربه توسط مدل صوتمحور جدیدی بهنام Gemini 3.1 Flash Live پشتیبانی میشود؛ مدلی که گوگل آن را بهطور ذاتی چندزبانه توصیف میکند. اهمیت این نکته در ظاهر کمتر از واقعیت نیست: بهجای ترجمهی پسینی، مدل بهصورت بومی برای «اندیشیدن» و پاسخ دادن به چند زبان طراحی شده است که کمک میکند تا تاخیر و عبارات نامناسب کاهش یابد. نتیجه: پاسخهای سریعتر و ریتم گفتوگویی طبیعتیتر و همگنتر.

جاهایی که قوی عمل میکند و جاهایی که ضعف دارد

زیر کاپوت، جستجوی زنده از تکنیکی بهنام query fan-out استفاده میکند. بهجای پاسخگویی به یک سؤال بهصورت مجزا، سیستم از پرسوجوهای مرتبط و متنهای همپیوند برای ساختن یک پاسخ غنیتر استفاده میکند. به همین دلیل پاسخها اغلب کمتر ساختاری و خشک بهنظر میرسند و ماهیتی کاوشگرانهتر پیدا میکنند، حتی وقتی خود سؤال ساده است.

اما کامل نیست. در آزمایشهای عملی، ابزار اشیایی مانند یک مدل خاص دوچرخه را بهدرستی تشخیص داد و حتی جزییات طراحی مثل نوع رنگآمیزی را توضیح داد. سپس لغزید: تغییرات پس از تولید (aftermarket)، لوازم جانبی دستساز و اصلاحات سفارشی را از دست داد یا اشتباه خواند، و گاهی به فرضیات قدیمی دربارهٔ پیکربندی اولیهٔ محصول بازگشت.

الگوی مشابهی در دیگر موارد هم دیده شد. یک مدل جدیدتر گوشی هوشمند بهعنوان نسخهای قدیمیتر شناسایی شد و وقتی با پاسخهای Gemini Live مقایسه شد، پاسخها تقریباً یکسان بودند — نشاندهندهٔ اینکه هر دو ابزار به منابع دادهای مشابهی متکیاند.

این خلاءها کاملاً غیرمنتظره نیستند. سیستمهای هوش مصنوعی از این نوع بهشدت به اطلاعات موجود آنلاین وابستهاند، که یعنی محصولات بسیار تازه یا اقلام بهشدت سفارشیشده میتوانند آنها را گمراه کنند. با این حال، برای سوالات روزمره و تشخیص عمومی اشیاء، عملکرد آن قابلقبول و مفید است.

آنچه عرضهٔ جهانی را جذاب میکند، فقط خود قابلیت نیست — مقیاس است. گوگل میگوید بیش از ۱.۵ میلیارد نفر تا میانهٔ ۲۰۲۵ از Lens استفاده کردهاند و Gemini Live هم حدود ۷۵۰ میلیون کاربر داشته است. جستجوی زنده دقیقاً در تقاطعِ این دو رفتار قرار میگیرد: دیدن و پرسیدن.

اگر این سرویس در سطح جهانی رواج یابد، ممکن است نحوهٔ تعامل مردم با جستجو را بهکلی تغییر دهد. تایپ کمتر، صحبت بیشتر و شاید در آینده، کمتر در مورد «جستجو» بهعنوان یک عمل جداگانه فکر کردن.

نحوه کار در عمل

برای کاربر نهایی، تجربه ساده و شهودی طراحی شده است، اما در پشت صحنه چندین لایهٔ پردازش همگرا میشوند:

- پردازش تصویر: فریمهای ویدیویی یا تصاویر ایستا ابتدا برای تشخیص اشیاء و استخراج ویژگیها تحلیل میشوند (تشخیص شی، تشخیص متن، تشخیص برند، و غیره).

- درک صوتی: ورودی صوتی کاربر به متن تبدیل میشود و سیستم قصد کاربر (intent) را استخراج میکند.

- همآوردسازی چندمنبع: نتایج بینایی، دادههای متن، تاریخچهٔ پرس و جو و منابع مرتبط وب ترکیب میشوند تا پاسخ جامعتری تولید شود.

- تولید زبان طبیعی: مدل زبان بزرگ (LLM) پاسخ نهایی را بهصورت گفتاری و متنی تولید میکند، همراه با زیرنویس و گزینهٔ follow-up برای ادامهٔ گفتوگو.

این فرآیند بهصورت بلادرنگ (real-time) رخ میدهد و برای حفظ روانی مکالمه، باید تاخیر شبکه و محاسباتی بسیار پایین نگه داشته شود. به همین دلیل، گوگل ادعا میکند مدل Gemini 3.1 Flash Live برای پردازش صوتی و تصویری بهینه شده و عملکرد چندزبانهٔ آن تا حدی روی کاهش زمان پاسخ متمرکز است.

بهینهسازی چندزبانه و حذف ترجمهٔ پسینی

یکی از ویژگیهای تمایزآمیز این سیستم، برخورداری از توانایی پاسخدهی مستقیم به چند زبان است بدون اینکه ابتدا متن را به یک زبان میانی ترجمه کند و سپس دوباره به زبان مقصد برگرداند. این کار چند مزیت فنی دارد:

- کاهش تاخیر: حذف گام ترجمهٔ میانی باعث میشود پاسخها سریعتر تولید شوند.

- طبیعیتر شدن عبارات: مدل بهطور مستقیم در زبانی که کاربر صحبت میکند فکر میکند و پاسخ میدهد، که احتمال ساخت عبارات نامتعارف یا اشتباه معنایی را کاهش میدهد.

- پشتیبانی بهتر از اصطلاحات محلی: مدل میتواند به صورت بومی اصطلاحات و لهجهها را مدیریت کند و تجربهٔ کاربری را در بازارهای غیرانگلیسیزبان بهبود دهد.

فناوری پشت پرده و نکات فنی

جستجوی زنده ترکیبی از چند حوزهٔ پیشتاز در هوش مصنوعی است: بینایی ماشین (computer vision)، پردازش زبان طبیعی (NLP)، تبدیل گفتار به متن (ASR) و تولید متن به گفتار (TTS). در سطح فنی، چند جنبه قابلتوجه وجود دارد:

معماری توزیعشده و Latency

برای پاسخ زنده و پیوسته، معماری باید توزیعشده باشد: برخی پردازشها میتوانند بهصورت محلی روی دستگاه انجام شوند (مثل فیلتر اولیهٔ تصویر یا ASR پایه) و برخی دیگر نیاز به سرویسهای ابری پرقدرت دارند (مثل تولید زبان پیچیده یا دسترسی به پایگاههای دانش بزرگ). این ترکیب «لبه-به-ابر» کمک میکند تا تعادل بین حریم خصوصی، زمان پاسخ و دقت برقرار شود.

منابع داده و بهروزرسانی مدل

مدلها برای پاسخهای دقیق به دادههای بزرگ و متنوعی نیاز دارند. از آنجا که جستجوی زنده به اطلاعات بصری نیز متکی است، مجموعهدادههای تصویری و ویدئویی با برچسبهای مرتبط، تصاویر محصول، اسناد فنی و صفحات وب به عنوان منابع آموزش و ارزیابی استفاده میشوند. با این حال، این وابستگی به دادههای آنلاین باعث میشود که محصولات تازه وارد یا موارد سفارشیشده دشوارتر شناسایی شوند.

امنیت و حریم خصوصی

وقتی دوربین و میکروفون در جریان یک مکالمهٔ زنده فعال هستند، نگرانیهای حریم خصوصی افزایش مییابد. گوگل معمولاً گزینههایی برای پردازش محلی، حذف خودکار تصاویر یا ذخیرهسازی محدود در نظر میگیرد، اما پیادهسازی و شفافیت سیاستها در هر بازار میتواند متفاوت باشد. کاربران و کسبوکارها باید توجه داشته باشند چه دادههایی ذخیره یا برای بهینهسازی مدلها استفاده میشوند.

موارد کاربرد و سناریوهای عملی

جستجوی زنده میتواند در چند حوزهٔ کاربردی محوری ارزش ایجاد کند:

- خرید و مقایسه: شناسایی مدلها، پیدا کردن قیمتها و مقایسهٔ مشخصات در زمان واقعی.

- راهنمایی تعمیر و نگهداری: تشخیص اجزا و ارائهٔ دستورالعملهای صوتی یا تصویری برای تعمیرات ساده یا تشخیص عیوب.

- آموزش و یادگیری: توضیح دستبهدست دربارهٔ ابزارها، گیاهان، آثار هنری یا مکانها در سفرهای آموزشی یا موزهها.

- دسترسپذیری: کمک به افراد با ناتوانیهای بینایی از طریق توصیف صوتی و تعاملی اشیاء پیرامونشان.

این سناریوها نشان میدهند چگونه «جستجوی بصری» و «جستجوی مکالمهای» میتوانند همافزایی داشته باشند تا تجربهٔ کاربر را غنیتر کنند.

چالشها، محدودیتها و نکات قابل بهبود

با وجود پیشرفتها، چند چالش عملی و فنی باقی میماند:

دقت در محیطهای پیچیده

در محیطهایی با نور کم، قطعات پوشیده یا تغییرات شدید بصری، دقت تشخیص کاهش مییابد. اقلامی که تغییرات فراوان یا سفارشیسازی زیادی دارند (مثل قطعات دستساز یا محصولات دومدست) میتوانند موجب تشخیص نادرست شوند.

رفتار غلط بهخاطر دادههای قدیمی

اگر مدلها یا منابع دادهای که به آنها مراجعه میشود بهروز نباشند، پاسخها ممکن است بر اطلاعات گذشته مبتنی باشند — مثلاً فرضیات مربوط به پیکربندی کارخانهای یک دستگاه که بعداً تغییر کرده است.

وابستگی به منابع یکسان

مشاهدهٔ پاسخهای مشابه بین جستجوی زنده و Gemini Live نشان میدهد که هر دو احتمالاً به مجموعهٔ مشابهی از دادهها و پایگاههای دانش متکیاند. تنوع منابع میتواند به پاسخهای قابلاطمینانتر و جامعتر کمک کند.

پیامدها برای آیندهٔ جستجو و تجربهٔ کاربری

اگر جستجوی زنده بهطور گستردهای پذیرفته شود، چند تغییر فرهنگی و فنی ممکن است رخ دهد:

- کاهش نیاز به تایپ و افزایش تعامل صوتی و تصویری با محتوای دیجیتال.

- ظهور الگوهای جدید جستجو که تلفیقی از «دیدن» و «پرسیدن» هستند، و بهبود تجربهٔ کاربری در اپلیکیشنهای موبایل و عینکهای هوشمند.

- فشار بیشتر برای استانداردسازی متادیتای تصویری محصولات و بهبود ایندکسگذاری بصری سایتها تا موتورهای جستجو بهتر بتوانند اطلاعات محصولات را بازیابی کنند.

بهعبارتی، این حرکت میتواند باعث شود پرسشگری بهعنوان یک عمل جداگانه کمتر تلقی شود و تعامل با اطلاعات بهصورت پیوسته و موقعیتی در زندگی روزمره رخ دهد.

نکات پایانی و توصیهها

جستجوی زنده یک گام مهم در تکامل جستجوی اینترنتی است که ترکیب بینایی ماشین و پردازش زبان طبیعی را در سطحی کاربردی برای کاربران عادی آورد. با این حال، برای بهرهمندی کامل:

- کاربران باید از تنظیمات حریم خصوصی و گزینههای ذخیرهسازی آگاه باشند.

- تولیدکنندگان محتوا و فروشندگان باید متادیتای تصویری و اطلاعات محصولات را بهصورت ساختاریافته منتشر کنند تا دیدپذیری در جستجوی بصری افزایش یابد.

- توسعهدهندگان باید تنوع منابع دادهای و روشهای بهروزرسانی مدلها را برای کاهش خطا و پاسخهای قدیمی بهبود دهند.

در مجموع، جستجوی زنده نشاندهندهٔ جهشی به سمت جستجوی مکالمهای و بصریتر است که میتواند تعامل با اینترنت را طبیعیتر و موقعیتیتر کند. اما مانند هر فناوری نوظهور، دقت، شفافیت در سیاستهای دادهای و بهروزرسانی مداوم مدلها کلید موفقیت بلندمدت آن خواهد بود.

ارسال نظر