6 دقیقه

از یک چتبات هوش مصنوعی قیمت سهام، تاریخ جلسه دادگاه یا نام یکی از مدیران یک شرکت را بپرسید، ممکن است پاسخی با اطمینان کامل دریافت کنید. بخش نگرانکننده همینجاست. جمله میتواند صیقلخورده به نظر برسد، لحن میتواند کاملا مطمئن باشد، اما واقعیتها همچنان اشتباه باشند.

یک تحلیل تازه درباره قابلیت اعتماد، از سوی لجال گاردین دیجیتال، یک شرکت سئو متمرکز بر مؤسسههای حقوقی، برای مشکلی که بسیاری از کاربران از قبل آن را میشناسند عدد و رقم ارائه کرده است: برخی چتباتهای محبوب هوش مصنوعی بسیار بیشتر از بقیه دچار توهم میشوند. با توجه به اینکه اکنون حدود یکچهارم کارکنان آمریکایی به طور منظم از ابزارهای هوش مصنوعی استفاده میکنند، تفاوت میان یک دستیار مفید و یک منبع قانعکننده اطلاعات نادرست اصلا جزئی نیست.

بخش ناراحتکننده: اطمینان به معنای دقت نیست

مدلهای زبانی بزرگ مانند انسان فکر نمیکنند. آنها آموزش میبینند تا بر اساس الگوهای موجود در حجم عظیمی از متن، واژهها و عبارتهای محتمل را پیشبینی کنند. وقتی سیستم زمینه کافی در اختیار داشته باشد، این فرایند میتواند پاسخهایی سریع و کاربردی تولید کند. اما وقتی زمینه کافی وجود ندارد، مدل همچنان ممکن است پاسخی بسازد که معقول به نظر برسد، چون از نظر آماری واژهها کنار هم جور درمیآیند.

معمولا وقتی گفته میشود یک چتبات هوش مصنوعی دچار توهم شده، منظور همین است. این خیالپردازی نیست. در معنای انسانی هم دروغگویی نیست. بلکه تولید پاسخی است که پشتوانه واقعی و قابل اعتماد ندارد. به همین دلیل نامها، تاریخها، ارجاعهای حقوقی، جزئیات پزشکی، ارقام مالی و اخبار فوری همچنان به راستیآزمایی انسانی نیاز دارند.

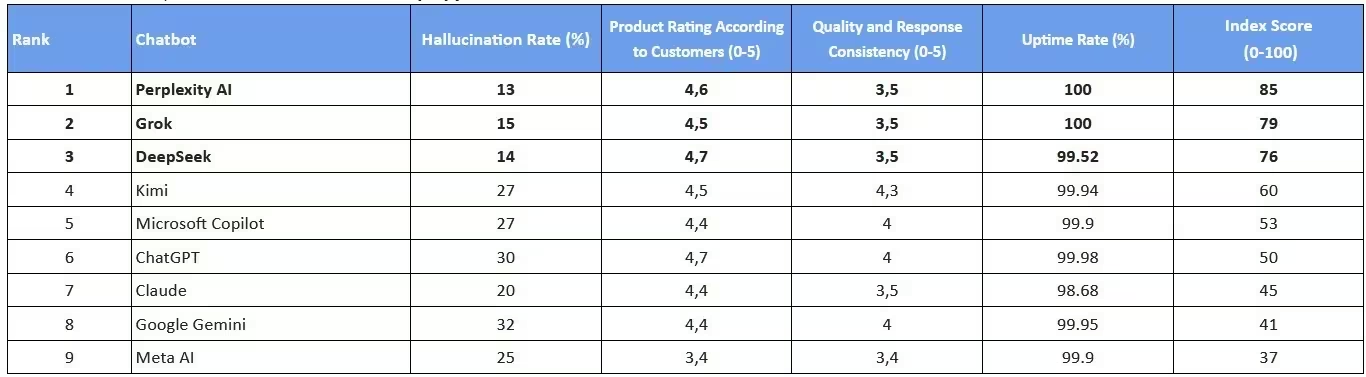

این مطالعه چند مدل شناختهشده هوش مصنوعی را از نظر نرخ توهم، رضایت مشتری، کیفیت پاسخ و میزان در دسترس بودن مقایسه کرده است. سپس این عوامل در یک امتیاز شاخص از ۰ تا ۱۰۰ ترکیب شدند تا تصویر گستردهتری از قابل اعتمادترین چتباتها در استفاده روزمره ارائه شود.

گوگل جمینای در این گروه بالاترین نرخ توهم را داشت و طبق گزارش، در ۳۲٪ از پاسخها اطلاعات نادرست تولید کرد. این عدد بهویژه از آن جهت جالب است که گزارشهایی وجود دارد مبنی بر اینکه اپل سالانه دستکم ۱ میلیارد دلار به گوگل میپردازد تا از یک مدل سفارشی جمینای با ۱.۲ تریلیون پارامتر برای ارتقای آینده سیری استفاده کند؛ ارتقایی که انتظار میرود همراه با آیاواس ۲۷ عرضه شود.

چتجیپیتی با فاصلهای نزدیک در جایگاه بعدی قرار گرفت و توهم در حدود سه پاسخ از هر ۱۰ پاسخ آن دیده شد. سادهتر بگوییم، اگر این ارقام پایدار بمانند، در این آزمون احتمال اینکه چتجیپیتی پاسخی اشتباه بدهد تقریبا دو برابر دیپسیک خواهد بود. این مقایسه احتمالا توجه زیادی جلب میکند، بهخصوص چون دیپسیک با کسری از هزینه آموزشی مدلهای پیشرو آمریکایی توسعه یافته است.

پرپلکسیتی ایآی بهترین عملکرد را از نظر نرخ توهم داشت و پاسخهای نادرست آن در ۱۳٪ موارد به کاربران رسید. دیپسیک با ۱۴٪ فاصله کمی داشت و گروک متعلق به ایلان ماسک نیز با ۱۵٪ در رتبه بعدی قرار گرفت. برای کاربرانی که در پژوهش، خلاصهسازی یا بررسی سریع واقعیتها به هوش مصنوعی تکیه میکنند، این فاصلهها اهمیت زیادی دارد.

آنلاین بودن هنوز مهم است

دقت فقط بخشی از ماجراست. یک چتبات ممکن است روی کاغذ فوقالعاده باشد، اما اگر زمانی که کاربر به آن نیاز دارد در دسترس نباشد، عملا بیفایده است. از نظر پایداری و در دسترس بودن، پرپلکسیتی ایآی و گروک تنها دو سرویسی بودند که در دوره آزمون همواره در دسترس باقی ماندند.

چتجیپیتی و جمینای فاصله زیادی نداشتند و به ترتیب نرخ دسترسی ۹۹.۹۸٪ و ۹۹.۹۵٪ را ثبت کردند. حتی کلود که کمترین میزان دسترسی را در این مطالعه داشت، با ۹۹.۶۸٪ همچنان بسیار قابل اعتماد باقی ماند. در عمل، بیشتر این ابزارها تقریبا همیشه آنلاین بودند، اما همین تفاوتهای بسیار کوچک نیز میتواند برای کسبوکارهایی که به گردش کار مبتنی بر هوش مصنوعی وابستهاند مهم باشد.

رضایت کاربران روایت دیگری داشت. دیپسیک و چتجیپیتی هر دو بالاترین امتیاز رضایت مشتری را با ۴.۷ از ۵ دریافت کردند. پرپلکسیتی ایآی با امتیاز ۴.۶ در رتبه بعدی قرار گرفت. متا ایآی با امتیاز ۳.۴ در پایین جدول نشست، در حالی که چند مدل دیگر پیرامون امتیاز ۴.۴ قرار گرفتند.

از نظر ثبات و کیفیت پاسخها، کیمی ایآی با امتیاز ۴.۳ از ۵ پیشتاز بود. چتجیپیتی، مایکروسافت کوپایلوت و جمینای همگی امتیاز ۴.۰ گرفتند. متا ایآی دوباره با امتیاز ۳.۴ در رتبه آخر قرار گرفت؛ موضوعی که نشان میدهد امتیاز کلی ضعیفتر آن نتیجه یک دستهبندی ضعیف واحد نبوده است.

وقتی همه عوامل با هم ترکیب شدند، پرپلکسیتی ایآی با امتیاز شاخص ۸۵ جایگاه نخست را به دست آورد. گروک با امتیاز ۷۹ دوم شد و پس از آن دیپسیک قرار گرفت. چتجیپیتی با امتیاز ۵۰ در رتبه ششم ایستاد، در حالی که جمینای با امتیاز ۴۱ رتبه هشتم را کسب کرد. متا ایآی نیز با امتیاز ۳۷ در پایینترین جایگاه قرار گرفت.

درس بزرگتر این نیست که باید به یک چتبات کورکورانه اعتماد کرد و دیگری را برای همیشه کنار گذاشت. ابزارهای هوش مصنوعی به سرعت تغییر میکنند. مدلها بهروزرسانی میشوند، چارچوبهای ایمنی تغییر میکنند و عملکرد میتواند تقریبا یکشبه بهتر شود. با این حال، چنین رتبهبندیهایی یادآوری مفیدی هستند: مشهورترین چتبات همیشه قابل اعتمادترین گزینه نیست و روانترین پاسخ همیشه پاسخ درست نیست.

برای هر کسی که در محیط کار از هوش مصنوعی استفاده میکند، ایمنترین رویکرد ساده است. با چتباتها مانند شتابدهنده کار برخورد کنید، نه مرجع نهایی. اجازه دهید پیشنویس تهیه کنند، سازماندهی کنند، خلاصه بسازند و ایدهپردازی کنند. اما وقتی پاسخ به پول، سلامت، قانون، هویت یا تصمیمی با پیامد واقعی مربوط میشود، پیش از اقدام، واقعیتها را بررسی کنید.

نظرات

توربو

معقوله، باید از چتباتها مثل ابزار کمکی استفاده کنیم نه منبع نهایی. هر چی مربوط به پول یا قانون باشه حتما چک دستی

دیتاویو

وااای یعنی جمینای ۳۲٪؟ یعنی بهتره همه چیزو دوباره چک کنیم مخصوصا ارقام مالی و تاریخ جلسات... ترسناک ولی واقعیه

ارسال نظر